资讯专栏INFORMATION COLUMN

摘要:反向传播算法算法是目前用来训练人工神经网络的最常用且最有效的算法。作为谷歌机器学习速成课程的配套材料,谷歌推出一个演示网站,直观地介绍了反向传播算法的工作原理。网站地址反向传播算法对于快速训练大型神经网络来说至关重要。

反向传播算法(BP算法)是目前用来训练人工神经网络的最常用且最有效的算法。作为谷歌机器学习速成课程的配套材料,谷歌推出一个演示网站,直观地介绍了反向传播算法的工作原理。网站地址:

https://google-developers.appspot.com/machine-learning/crash-course/backprop-scroll/

反向传播算法对于快速训练大型神经网络来说至关重要。本文将介绍该算法的工作原理。

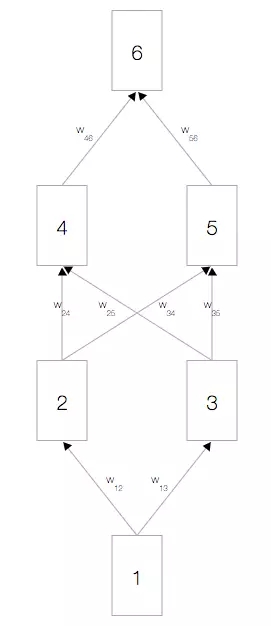

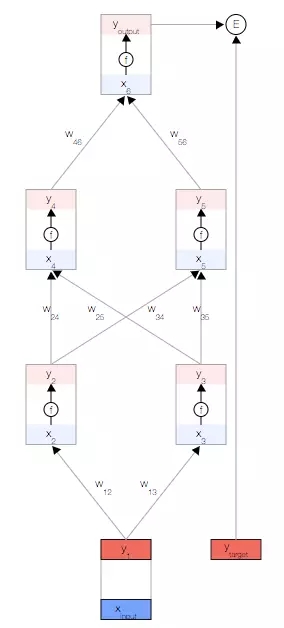

简单的神经网络

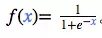

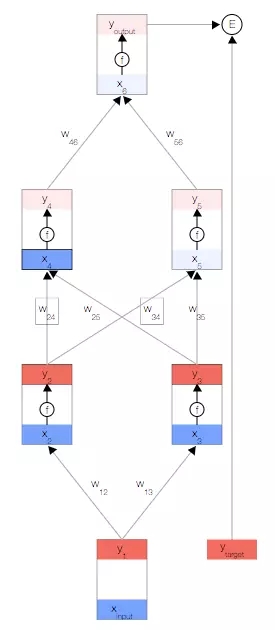

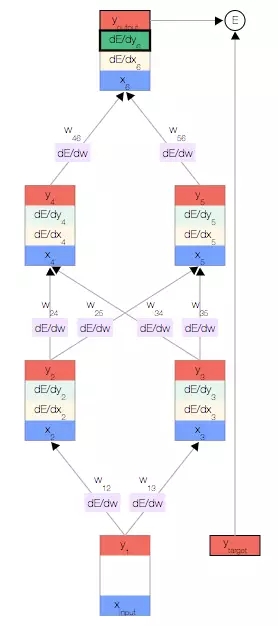

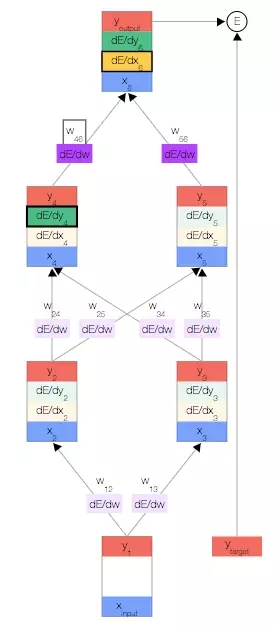

如上图,你会看到一个神经网络,其中包含一个输入节点、一个输出节点,以及两个隐藏层(分别有两个节点)。

激活函数

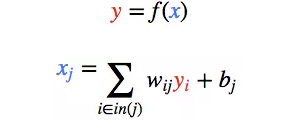

每个节点都有一个总输入 x、一个激活函数 f(x) 以及一个输出 y=f(x)。

f(x)必须是非线性函数,否则神经网络就只能学习线性模型。

常用的激活函数是 S 型函数:

误差函数

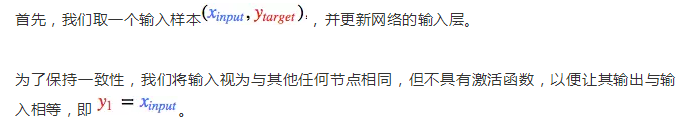

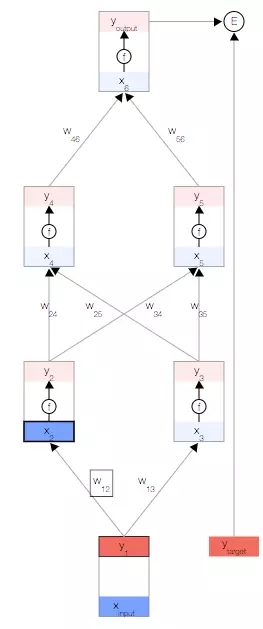

正向传播

现在,我们更新第一个隐藏层。我们取上一层节点的输出 y,并使用权重来计算下一层节点的输入 x。

然后,我们更新第一个隐藏层中节点的输出。 为此,我们使用激活函数 f(x)。

使用这两个公式,我们可以传播到网络的其余内容,并获得网络的最终输出。

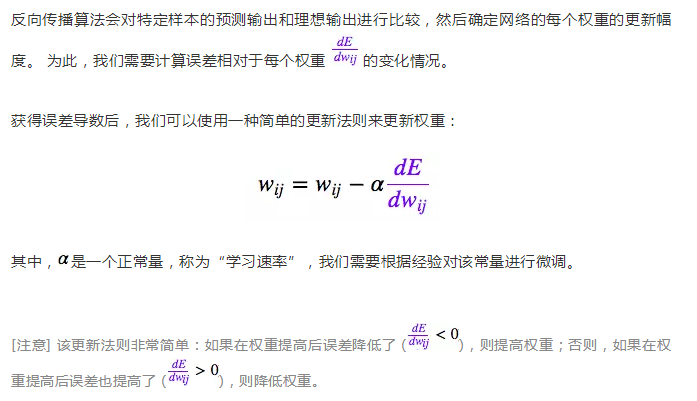

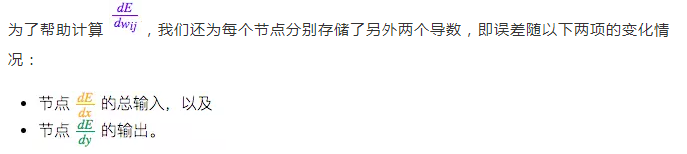

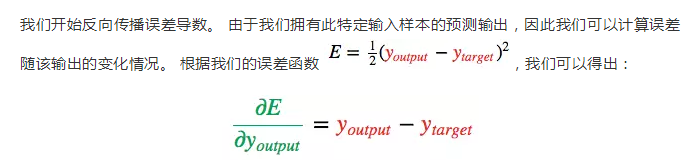

误差导数

其他导数

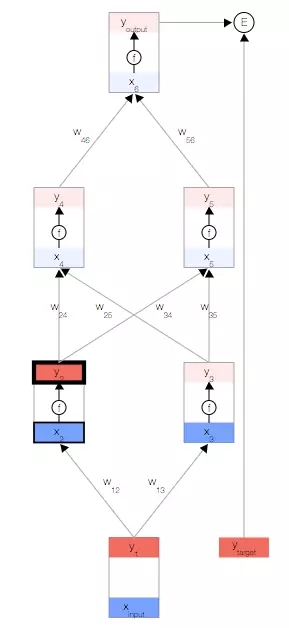

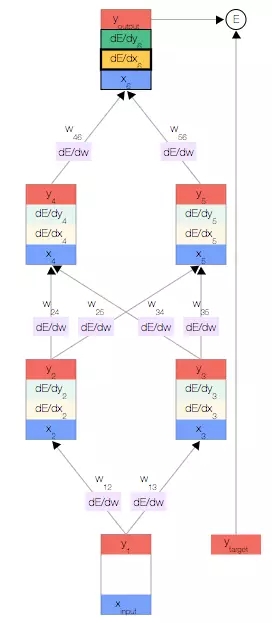

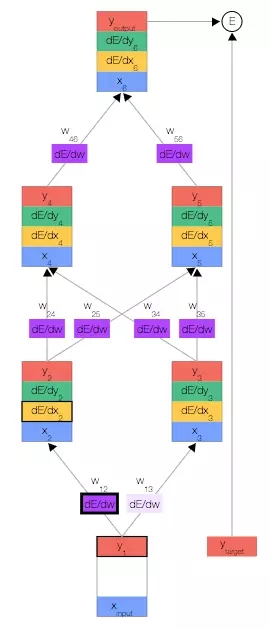

反向传播

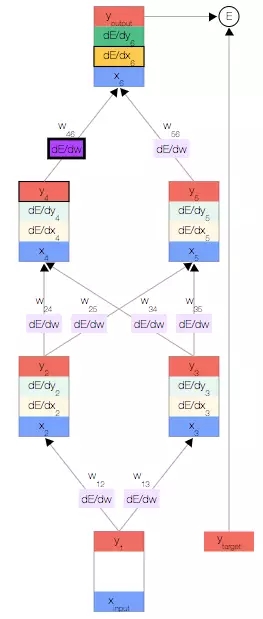

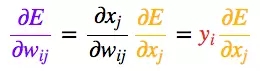

一旦得出相对于某节点的总输入的误差导数,我们便可以得出相对于进入该节点的权重的误差导数。

接下来,只需重复前面的 3 个公式,直到计算出所有误差导数即可。

结束。

声明:文章收集于网络,如有侵权,请联系小编及时处理,谢谢!

欢迎加入本站公开兴趣群商业智能与数据分析群

兴趣范围包括各种让数据产生价值的办法,实际应用案例分享与讨论,分析工具,ETL工具,数据仓库,数据挖掘工具,报表系统等全方位知识

QQ群:81035754

文章版权归作者所有,未经允许请勿转载,若此文章存在违规行为,您可以联系管理员删除。

转载请注明本文地址:https://www.ucloud.cn/yun/4795.html

摘要:在最近的一次人工智能会议上,表示自己对于反向传播非常怀疑,并提出应该抛弃它并重新开始。在人工智能多年的发展过程中,反向传播已经成为了深度学习不可或缺的一部分。最后,我们会将这些规则组合成可用于任意神经网络的反向传播算法。 现在的深度学习发展似乎已经陷入了大型化、深度化的怪圈,我们设计的模型容易被对抗样本欺骗,同时又需要大量的训练数据——在无监督学习上我们取得的突破还很少。作为反向传播这一深度...

阅读 882·2021-11-22 15:25

阅读 1513·2021-09-08 09:45

阅读 1815·2021-09-02 09:46

阅读 1417·2019-08-30 15:56

阅读 1586·2019-08-29 15:14

阅读 1215·2019-08-29 13:06

阅读 2057·2019-08-29 12:34

阅读 1451·2019-08-26 12:14