资讯专栏INFORMATION COLUMN

摘要:是世界上最重要的研究者之一,他在谷歌大脑的竞争对手,由和创立工作过不长的一段时间,今年月重返,建立了一个探索生成模型的新研究团队。机器学习系统可以在这些假的而非真实的医疗记录进行训练。今年月在推特上表示是的,我在月底离开,并回到谷歌大脑。

理查德·费曼去世后,他教室的黑板上留下这样一句话:“我不能创造的东西,我就不理解。”(What I cannot create, I do not understand.)

Ian Goodfellow 在解释他在 Google Brain 所做的研究时,引用了这位伟大的物理学家的这句名言,费曼是加州理工学院教授,同时也是畅销书作者。但 Goodfellow 指的不是自己,也不是 Google 内部的其他任何人。他指的是机器:“ AI 不能创造的东西,它就不理解。”

Goodfellow 是世界上最重要的 AI 研究者之一,他在 OpenAI(谷歌大脑的竞争对手,由 Elon Must 和 Sam Altman 创立)工作过不长的一段时间,今年3月重返 Google Brain,建立了一个探索“生成模型”(generative models)的新研究团队。生成模型是创造照片、声音、以及其他现实世界的表征的系统。Goodfellow 将这些工作描述为通向各种各样的人工智能的重要途径。

“如果 AI 能够想象这个世界的现实细节——学习如何创造逼真的图像和逼真的声音——就能让 AI 得以学习现实世界的结构。”他解释说,“这能帮助 AI 理解它看到的图像或听到的声音。”

2014年,还是蒙特利尔大学的博士生时,一次在一家酒吧稍微喝醉与人争论,Goodfellow 设想了这样一种被称为“生成对抗网络”,即 GAN 的 AI 技术。虽然其起源有酒精的因素,但这是一个非常优雅的设想:一个 AI 能够创造出足以乱真的假图像,然后第二个 AI 分析其结果,并判断这些图像是真实的还是假造的。“你可以把它想象成一个艺术家和一个艺术评论家,”Goodfellow 说,“生成模型想要骗过艺术评论家——让艺术评论家认为它产生的图像是真实的。”由于第二个 AI 要识别出图像是假的非常困难,第一个 AI 学会了以这样的方式模仿真实的图像,而它独自是没法做到的。在这个过程中,这两个神经网络能够将 AI 推向计算机宣布完全脱离它们的人类老师的一天。

Facebook AI 研究主管 Yann LeCun 称 GAN 是“过去20年来深度学习方面最酷的想法”。深度学习是 AI 的一个子领域,它正在改变所有互联网大公司的方向,包括 Google,微软,Amazon,以及 Facebook。Goodfellow 的想法虽然尚未成熟仍在不断发展,但它们已经迅速在 AI 社区中广为传播。许多研究者,包括 LeCun,相信 GAN 能够达成“无监督学习”,这是 AI 研究领域的一个强烈愿景:不需要人类直接帮助的机器学习。

让 Goodfellow 冒出这个想法的酒吧叫 Les 3 Brasseurs,或称 The 3 Brewers。他的朋友 Razvan Pascanu,现在是 DeepMind 的研究员,当时刚完成博士学位,Goodfellow 以及其他许多朋友一起聚在那个酒吧为他庆祝。其中一位朋友说起一个新的研究项目,研究如何在数学上确定一张照片里的所有信息。他们的想法是将这些统计数据输入到一台机器,然后让机器自己创造照片。已经喝得微醺的 Goodfellow 说这永远不可能奏效,因为需要考虑的数据太多,没有人能够把所有数据记录下来。但这时,他想到了一个更好的方法:可以让神经网络去教会机器如何创造逼真的图像。

神经网络是一个复杂的数学系统,通过分析大量数据来学习任务,从识别照片中的人脸到理解对话,等等。在那间酒吧里,Goodfellow 想到在一个神经网络学会创造逼真的图像后,第二个神经网络可以当它的对手,试图判断这些图像是否是假造的,然后,将这个判断输入给第一个网络。Goodfellow 说,通过这种方式,最终能教会第一个神经网络生成足以乱真的“假造”图像。

这随后引来了争论。Goodfellow 的朋友们同样坚持这种方法不会奏效。所以,当天晚上 Goodfellow 回家后,他就开始着手建这个东西。“我回到家时还是有点醉醺醺的,女朋友已经睡着了,然后我就坐在那里想:‘是我的朋友们是错的!’”他回忆道:“然后我就熬夜用 laptop 写出了 GAN 的代码。”正如他的想法那般,代码在第一次尝试是就奏效了。“真的很幸运,”他说,“因为假如它第一次不工作,我可能就放弃这个想法了。”

当年晚些时候,Goodfellow 和其他一些研究人员合作发表了一篇论文,描述了这些想法。三年来,探讨这个概念的论文已经有数百篇。在 Goodfellow 的第一篇 GAN 论文里,两个神经网络一起工作,产生了一个能够生成手写数字的逼真图像的系统。现在,研究人员已经将这个想法应用到猫、火山乃至整个星系的图像。GAN 甚至能协助天文学实验,帮助模拟粒子物理。

但这仍然是非常难以实现的想法。它需要训练的不仅仅是一个神经网络,而是要同时训练两个神经网络。Goodfellow 在 Google 创建专注于 GAN 及其相关研究的新团队时,他希望能够改进这个过程。他说:“我作为一名机器学习的研究者,必须面对的一个主要问题,是提供一种能够非常可靠地训练这些网络的方法。”

最终的结果:不仅是生成图像和声音,而且在识别图像和声音方面,GAN 都能做得非常好,而识别图像和声音是通往不需人类太多帮助就能学习的系统的一个路径。Goodfellow 说:“这些模型学会了理解世界的构造,这能帮助系统在没有很多明确的告知的情况下学习。”

GAN 甚至能够提供无监督学习,虽然这在目前还没有真正实现。目前,神经网络可以通过分析几百万张猫的照片来学习识别猫,但这需要人工地仔细甄别这些照片,并将它们标记为猫的照片。在这个过程中,人仍然是很重要的角色,而且这往往是很大的问题,例如偏见的问题,训练 AI 所需的庞大的人力的问题,等等。LeCun 等研究者正在推动不需这样庞大的人力参与的情况下学习的系统,这可以加速 AI 的发展。

但这仅仅是个开始。GAN 也带来了数量众多的可能性。南加州大学的AI 研究员David Kale 认为,GAN 将会帮助他和他的同事在不侵犯病人隐私的前提下开发医疗AI。

基本上,GAN 可以“制造出”假的医疗记录。机器学习系统可以在这些假的而非真实的医疗记录进行训练。“与其把病人的医疗记录放到互联网上,让大家都来用,为什么不在这样的数据上训练GAN,创造出一个完全人造的数据集,并且对所有的研究者开放呢?” Kale 说。“为什么我们不这样做?毕竟从这个数据集训练的模型与原始数据训练并没有什么区别。”

尽管现在有很多研究者都在探索GAN背后的原理,但是,GoodFellow 将在谷歌建立自己的研究团队却格外引人注目。GoodFellow 早年在谷歌,后加入Open AI,在不到一年以后又返回谷歌,因为他所有的合作者几乎都在谷歌。

Goodfellow 今年3月在推特上表示:

是的,我在 2月底离开 OpenAI,并回到谷歌大脑。

我很喜欢在 OpenAI 的日子,也为 OpenAI 的同事们与我合作完成的工作感到自豪。我重回谷歌大脑,是因为随着时间的推移,我发现我的研究集中在对抗样本,以及与差分隐私相关的技术,而这些研究我主要是与谷歌的同事合作进行的。

“每天都把时间花费在视频电话上,这可不好玩”,他说,“这不是做事的较佳方法”。分享很重要,但是,近距离的协作也很重要,不管对于AI研究者还是神经网络都是如此。

关于生成对抗网络的详细介绍

摘要

我们提出一个通过对抗过程评估生成模型的新框架,其中我们同时训练两个模型:一个用于捕捉数据分布的生成模型 G,以及一个用于评估来自训练数据而非来自生成模型 G 的样本概率的判别模型 D。生成模型 G 的训练过程目的是较大化判别模型 D 犯错误的概率。这个框架相当于一个极小化极大的双方对弈。在任意函数 G 和 D 的空间中,存在一个的解,此时 G 恢复训练数据的分布,而 D 处处都等于 1/2。在 G 和 D 由多层感知器(multilayer perceptrons)定义的情况下,整个系统可以用反向传播进行训练。在训练或生成样本时,不需要任何马尔科夫链(Markov chains)或展开的近似推理网络(unrolled approximate inference networks)。实验通过对生成的样本进行定性或定量评估来证明这个框架的潜力。

论文地址:https://arxiv.org/pdf/1406.2661.pdf

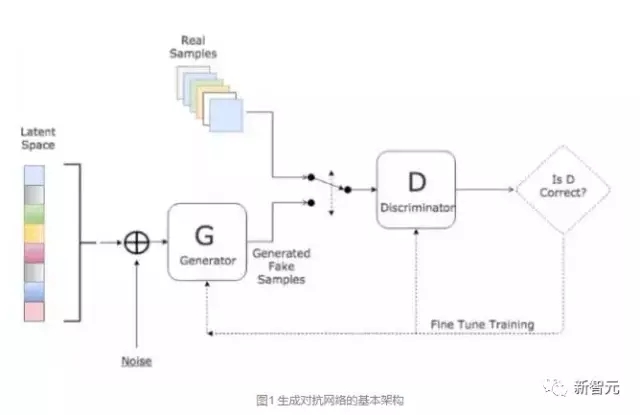

生成对抗网络的简单介绍如下,训练一个生成器(Generator,简称G),从随机噪声或者潜在变量(Latent Variable)中生成逼真的的样本,同时训练一个鉴别器(Discriminator,简称D)来鉴别真实数据和生成数据,两者同时训练,直到达到一个纳什均衡,生成器生成的数据与真实样本无差别,鉴别器也无法正确的区分生成数据和真实数据。GAN的结构如图1所示。

Ian Goodfellow在生成对抗网络(GAN)论文最后总结的几点:

优点

模型只用到了反向传播,而不需要马尔科夫链;

训练时不需要对隐变量做推断;

理论上,只要是可微分函数都可以用于构建D和G,因为能够与深度神经网络结合做深度生成式模型;

G的参数更新不是直接来自数据样本,而是使用来自D的反向传播(这也是与传统方法相比差别较大的一条吧)。

缺点

可解释性差,生成模型的分布 Pg(G)没有显式的表达。

比较难训练,D与G之间需要很好的同步,例如D更新k次而G更新一次。

Ian Goodfellow

Ian Goodfellow 是深度学习大神 Yoshua Bengio的学生,以第一作者的身份和Bengio、Allan Courville合著了“Deep Learning”这本书——是的,就是【那本】Deep Learning。

LinkedIn 页面显示 Goodfellow 的职业轨迹:

2013年6月到2013年9月,在谷歌实习,职位:软件工程师

2014年7月到2015年11月,谷歌研究员

2015年11月到2016年3月,谷歌高级研究员

2016年3月到2017年3月,Open AI 研究员

2017年3月到现在,谷歌 Staff Research Scientist

原文地址:https://www.wired.com/2017/04/googles-dueling-neural-networks-spar-get-smarter-no-humans-required/

欢迎加入本站公开兴趣群商业智能与数据分析群

兴趣范围包括各种让数据产生价值的办法,实际应用案例分享与讨论,分析工具,ETL工具,数据仓库,数据挖掘工具,报表系统等全方位知识

QQ群:81035754

文章版权归作者所有,未经允许请勿转载,若此文章存在违规行为,您可以联系管理员删除。

转载请注明本文地址:https://www.ucloud.cn/yun/4529.html

摘要:据报道,生成对抗网络的创造者,前谷歌大脑著名科学家刚刚正式宣布加盟苹果。他将在苹果公司领导一个机器学习特殊项目组。在加盟苹果后会带来哪些新的技术突破或许我们很快就会看到了。 据 CNBC 报道,生成对抗网络(GAN)的创造者,前谷歌大脑著名科学家 Ian Goodfellow 刚刚正式宣布加盟苹果。他将在苹果公司领导一个「机器学习特殊项目组」。虽然苹果此前已经缩小了自动驾驶汽车研究的规模,但...

摘要:但年在机器学习的较高级大会上,苹果团队的负责人宣布,公司已经允许自己的研发人员对外公布论文成果。苹果第一篇论文一经投放,便在年月日,斩获较佳论文。这项技术由的和开发,使用了生成对抗网络的机器学习方法。 GANs「对抗生成网络之父」Ian Goodfellow 在 ICCV 2017 上的 tutorial 演讲是聊他的代表作生成对抗网络(GAN/Generative Adversarial ...

摘要:二是精度查全率和得分,用来衡量判别式模型的质量。精度查全率和团队还用他们的三角形数据集,测试了样本量为时,大范围搜索超参数来进行计算的精度和查全率。 从2014年诞生至今,生成对抗网络(GAN)热度只增不减,各种各样的变体层出不穷。有位名叫Avinash Hindupur的国际友人建立了一个GAN Zoo,他的动物园里目前已经收集了多达214种有名有姓的GAN。DeepMind研究员们甚至将...

摘要:论文可迁移性对抗样本空间摘要对抗样本是在正常的输入样本中故意添加细微的干扰,旨在测试时误导机器学习模型。这种现象使得研究人员能够利用对抗样本攻击部署的机器学习系统。 现在,卷积神经网络(CNN)识别图像的能力已经到了出神入化的地步,你可能知道在 ImageNet 竞赛中,神经网络对图像识别的准确率已经超过了人。但同时,另一种奇怪的情况也在发生。拿一张计算机已经识别得比较准确的图像,稍作调整,...

摘要:在这项工作中,我们提出了自注意力生成对抗网络,它将自注意力机制引入到卷积中。越高,表示图像质量越好。表将所提出的与较先进模型进行比较,任务是上的类别条件图像生成。 图像合成(Image synthesis)是计算机视觉中的一个重要问题。随着生成对抗网络(GAN)的出现,这个方向取得了显著进展。基于深度卷积网络的GAN尤其成功。但是,通过仔细检查这些模型生成的样本,可以观察到,在ImageNe...

阅读 1427·2021-11-11 11:00

阅读 3381·2021-09-24 09:47

阅读 5603·2021-09-22 15:53

阅读 1085·2021-09-10 10:50

阅读 3311·2021-09-01 11:40

阅读 1258·2019-08-30 15:55

阅读 551·2019-08-30 12:49

阅读 1187·2019-08-29 17:12