资讯专栏INFORMATION COLUMN

DeepSeek-R1-671b动态量化版,由unsloth.ai发布,推荐使用多卡进行部署,具体操作如下。本镜像还附带32b的无限制版蒸馏模型,使用open-webui和ollama以及llama.cpp进行部署,内置所有环境,即拉即用。

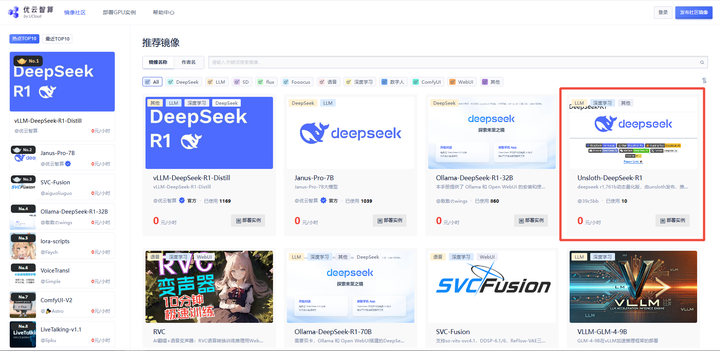

第一步:登录「优云智算」算力共享平台并进入「镜像社区」,新用户免费体验10小时4090

地址:https://www.compshare.cn/?ytag=seo

第二步:选择「vLLM-DeepSeek-R1-Distill」镜像,点击「使用该镜像创建实例」

镜像地址:优云智算 | Unsloth-DeepSeek-R1一键部署

根据镜像说明中的引导,选择所用模型需要的GPU算力规格,并点击「立即部署」即可拥有一个自带模型的算力资源。(动态量化版本推荐使用4卡或8卡4090)

第三步:启动服务,镜像已配置好所需依赖环境,无需额外安装,即可通过以下命令启动:

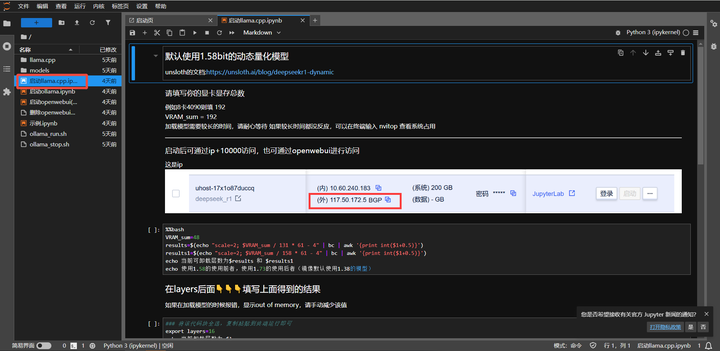

打开jupyterlab

按照指引启动llama.cpp

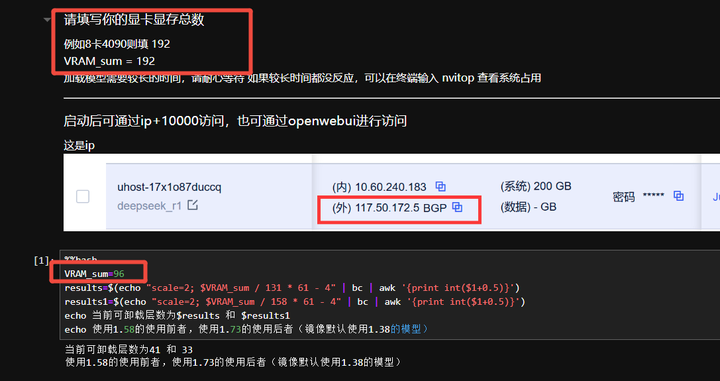

根据所开的机器卡数填写对应的显存大小

按照指引将代码块修改并复制到终端中运行

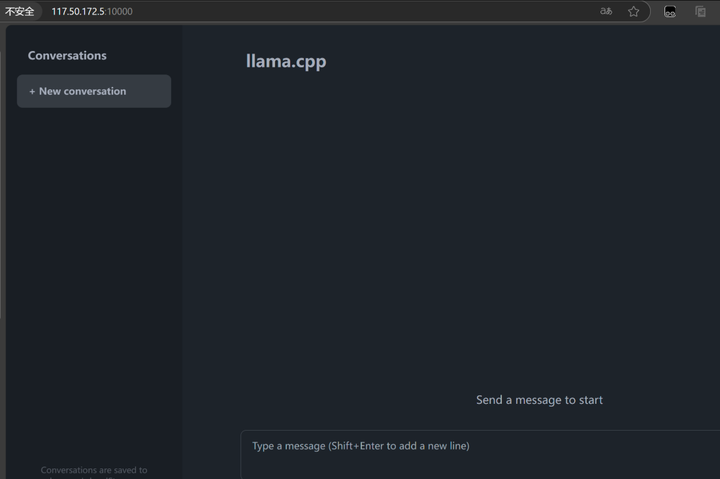

运行完成后,访问外网IP:10000即可开始使用

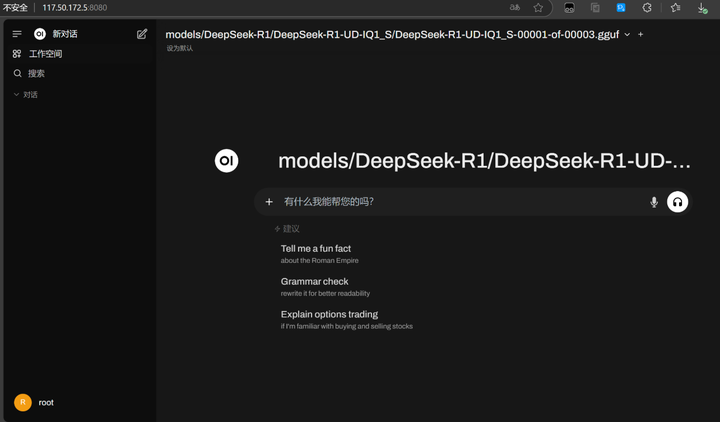

使用llama.cpp加载模型以后,再启动open-webui,访问ip:8080是这样

注意:

1、unsloth文档给了四个模型,镜像默认选择1.58的作为默认配置

2、部署1.58bit的如果需要全部加载到显存上,需要2x80GB的显卡,换算成24g的4090需要挺多张,但是相较于需要一大堆H100的671b的原本模型,所用配置已经相当低了,全部加载到内存上推理可能会比较慢,因此可以通过将部分layer卸载到显存上从而加快推理速度

3、单卡4090的话不是很推荐,显存内存加在一起都有点放不下,只有0.17token/s;双卡4090,layer为17或者16,大概1.5token/s到2tokens/s之间,再多的话没测过,虽然这速度也不是不能用,三卡应该就能正常用了,当然,选择更大显存的A100或者8卡4090,即可全部吃下,飞快使用

4、该镜像还搭载了Ollama,你不想使用R1模型的话也可以试试蒸馏模型,单卡4090妥妥够了,70b的那个中文效果还不如32g,镜像内自带的两个蒸馏模型分别是32b官方版和32b越狱般。启动ollama服务后,再启动open-webui,进入到open-webui即可使用

5、量化模型也可以在llama.cpp的serve上面推,open-webui并不是必须的

文章版权归作者所有,未经允许请勿转载,若此文章存在违规行为,您可以联系管理员删除。

转载请注明本文地址:https://www.ucloud.cn/yun/131186.html

DeepSeek-R1 Distill系列基于DeepSeek-R1的推理能力,通过蒸馏技术将推理能力迁移到较小的模型上,在保持高效性能的同时,成功降低了计算成本,实现了小身材、大智慧的完美平衡!该镜像使用vLLM部署提供支持,适用于高性能大语言模型的推理和微调任务,第一步:登录「优云智算」算力共享平台并进入「镜像社区」地址:https://www.compshare.cn/?ytag=seo 第...

DeepSeek-R1-32B-WebUIDeepSeek-R1采用强化学习进行后训练,旨在提升推理能力,尤其擅长数学、代码和自然语言推理等复杂任务,该镜像安装和使用 Ollama 和 Open WebUI,以便更好地利用深度学习模型进行推理和交互。第一步:登录「优云智算」算力共享平台并进入「镜像社区」地址:https://www.compshare.cn/?ytag=seo第二步:选择「Deep...

2月10日,清华大学KVCache.AI团队联合趋境科技发布的KTransformers开源项目公布更新:一块24G显存的4090D就可以在本地运行DeepSeek-R1、V3的671B满血版。预处理速度最高达到286 tokens/s,推理生成速度最高能达到14 tokens/s。KTransformers通过优化本地机器上的LLM部署,帮助解决资源限制问题。该框架采用了异构计算、先进量化技术、...

摘要:量化派是一家数据驱动的科技金融公司,通过人工智能大数据机器学习等前沿技术提供消费信贷撮合及消费场景下的白条服务,每年处理千万级用户信用及信用消费申请。 「小杨」最近装修房子,准备去银行贷款,但是听说好多人会因为个人征信问题被银行拒绝贷款!于是,他先查了一下自己的央行征信,发现竟然没有自己的征信信息,「小杨」陷入了沉思,自己经常在淘宝、jd 上买东西,也有淘宝花呗和京东白条,怎么会没有征...

阅读 11752·2025-03-21 11:44

阅读 560·2025-02-19 18:27

阅读 638·2025-02-19 18:21

阅读 609·2025-02-19 13:50

阅读 1749·2025-02-13 22:35

阅读 1288·2025-02-08 10:20

阅读 5959·2025-01-02 11:25

阅读 1297·2024-12-10 11:51